El cerebro que programa robots y los puntos ciegos que nadie audita

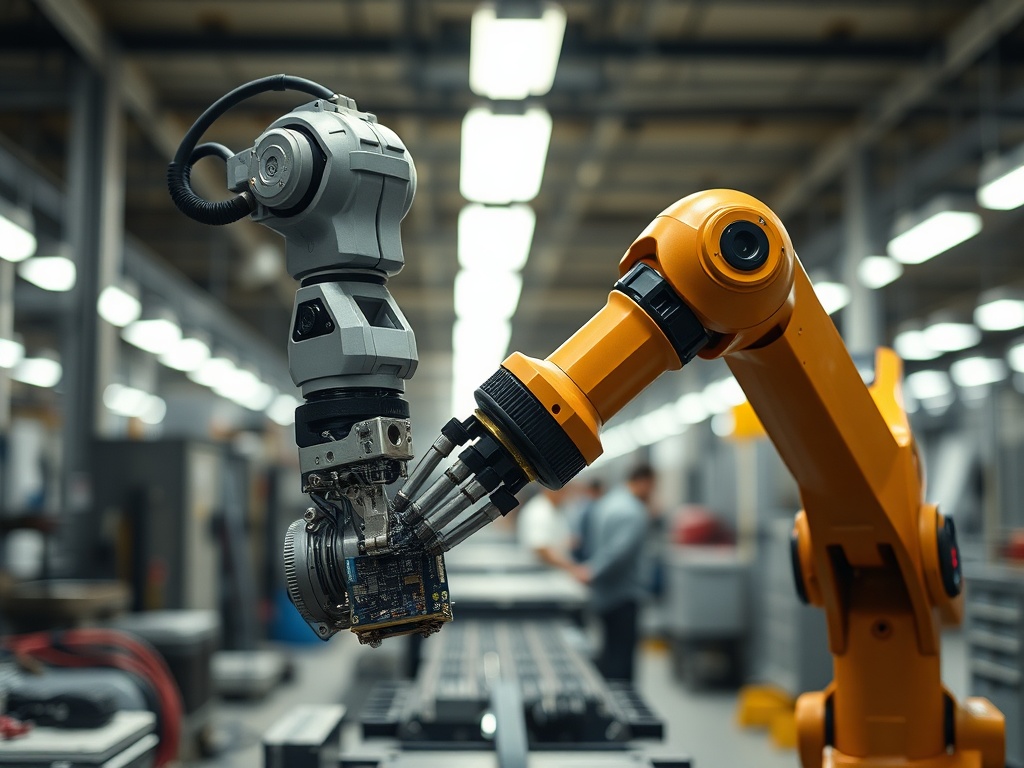

El 16 de marzo de 2026, Skild AI anunció algo que la industria de la automatización llevaba décadas prometiendo sin cumplir: un modelo de inteligencia artificial capaz de controlar cualquier robot, para cualquier tarea, sin necesidad de programación específica por aplicación. Lo llaman Skild Brain. Sus alianzas con ABB Robotics, Universal Robots, Mobile Industrial Robots y NVIDIA, sumadas a un despliegue en las líneas de ensamblaje de los sistemas Blackwell de NVIDIA a través de Foxconn, convirtieron el anuncio en la señal más concreta de que la robótica general dejó de ser un paper académico para convertirse en infraestructura productiva.

Los números son difíciles de ignorar. 60% a 80% de desempeño en tareas nuevas dentro de horas de recopilación de datos. Capacidad de adaptarse a cargas de hasta 1,5 veces el peso del robot. Un costo de despliegue de entre 4.000 y 15.000 dólares por unidad frente a los más de 250.000 que exigen los sistemas tradicionales de automatización personalizada. El CEO Deepak Pathak lo sintetizó con precisión: la robótica está en el mismo punto de inflexión en que estaban los modelos de lenguaje hace unos años. No es retórica. Es una descripción técnica del momento.

Pero hay una dimensión de este lanzamiento que los comunicados de prensa no cubren, y que como analista de capital social y equidad estructural, no puedo ignorar: cuando una tecnología promete automatizar decisiones físicas en el mundo real a escala industrial, la composición del equipo que la diseñó deja de ser un dato de recursos humanos y se convierte en una variable de riesgo financiero.

La promesa técnica y lo que la sostiene

Skild Brain funciona como lo que sus creadores denominan un modelo de base omnidireccional: entrena sobre datos sintéticos generados en simulación, videos de comportamiento humano disponibles en internet, y datos reales recogidos en despliegues productivos. No aprende una tarea; aprende a aprender tareas. La infraestructura que lo sostiene incluye sistemas HPE Cray XD670 con NVIDIA HGX H200 para entrenamiento y ocho NVIDIA L40S para visualización, además de los modelos de simulación física Cosmos e Isaac Lab de NVIDIA.

Lo que hace que este modelo sea estratégicamente distinto de sus competidores no es solo la capacidad técnica, sino la estructura del dato que lo alimenta. Cada despliegue productivo genera nuevos datos que mejoran el modelo, que habilita nuevos despliegues, que generan más datos. Es un ciclo de retroalimentación cuya velocidad escala con el número de socios OEM. ABB, Universal Robots y MiR no son solo clientes; son nodos de una red de aprendizaje distribuido. La ventaja competitiva de Skild no está solo en el modelo: está en la velocidad con la que ese modelo se actualiza en condiciones reales.

Esto tiene implicaciones financieras directas. Con 1.400 millones de dólares de financiamiento, Skild está construyendo lo que internamente llaman una fábrica de IA, integrando entrenamiento y producción en un solo flujo. La licencia del modelo vía API a los OEMs genera ingresos recurrentes mientras el volumen de despliegues reduce progresivamente el costo marginal de adaptación a nuevas tareas. La economía unitaria del modelo se fortalece con el tiempo, no se erosiona. Eso es estructuralmente diferente a vender hardware o consultoría de automatización.

El sesgo que se entrena antes de que nadie lo note

Aquí está la tensión que me interesa diagnosticar. Skild Brain aprende de dos fuentes principales: simulaciones físicas generadas algorítmicamente y videos de comportamiento humano disponibles en internet. El segundo componente es el que exige mayor escrutinio.

Los videos de comportamiento humano que pueblan internet no son una muestra representativa de cómo los seres humanos interactúan con el mundo físico. Reflejan los patrones de quienes producen y consumen contenido digital de forma masiva: franjas demográficas específicas, geografías concretas, tipos de entornos laborales y domésticos que están sobrerrepresentados en la web. Un modelo entrenado sobre esa base aprenderá a manipular objetos, navegar espacios y recuperarse de fallas según los patrones físicos de ese subconjunto, no según la diversidad real de los entornos industriales donde será desplegado.

Esto no es especulación. Es la mecánica documentada del sesgo en sistemas de aprendizaje por imitación. Cuando ese sesgo se instala en un robot que opera en una planta de manufactura en Malaysia, en una obra de construcción en México o en un almacén de logística en Nigeria, la brecha entre el comportamiento entrenado y el entorno real genera fallas de desempeño que ningún benchmark de laboratorio anticipa. Y esas fallas tienen costos operativos concretos, no abstractos.

La pregunta que los tableros de directorio de los socios OEM deberían estar haciendo no es si el modelo funciona en Pittsburgh. Es si el equipo que diseñó los criterios de selección de datos de entrenamiento incluía personas con experiencia directa en los entornos físicos donde el modelo será desplegado a escala. Porque si ese equipo es homogéneo en términos de origen, geografía y experiencia laboral, los puntos ciegos del modelo no son accidentes técnicos. Son consecuencias predecibles de una arquitectura social deficiente en la mesa de diseño.

Lo que un capital social robusto haría diferente

Las alianzas de Skild con ABB, Universal Robots y MiR son transaccionalmente sólidas. Cada OEM aporta volumen de despliegue; Skild aporta inteligencia. El ciclo se cierra sobre sí mismo. Pero hay una diferencia crítica entre una red de socios transaccionales y una red con capital social genuino: la primera maximiza el flujo de datos dentro de los parámetros ya conocidos; la segunda expande activamente los parámetros.

Una red con capital social robusto incorporaría en el diseño del modelo a operadores de planta en mercados emergentes, a técnicos de mantenimiento con décadas de experiencia en condiciones no controladas, a trabajadores que conocen los bordes irregulares del mundo físico que ninguna simulación reproduce fielmente. No como consultores externos que validan un producto terminado, sino como participantes activos en la definición de qué datos importan y por qué.

Eso no es altruismo corporativo. Es ingeniería de resiliencia. Los modelos que fallan en condiciones extremas o en contextos no representados en sus datos de entrenamiento no fallan silenciosamente: generan incidentes operativos, demandas de responsabilidad y, en el mejor de los casos, costos de reentrenamiento que erosionan exactamente la ventaja de costo que Skild promete. La reducción de 10 veces en el costo de propiedad que el modelo promete solo se sostiene si la tasa de falla en producción permanece baja. Y esa tasa depende directamente de cuán representativos son los datos con los que el modelo aprendió.

El financiamiento de 1.400 millones de dólares da a Skild la capacidad de construir esa red de otra manera. La escasez no es de capital. Es de voluntad estructural para incluir en la arquitectura del dato las voces que no aparecen en los videos de internet.

La fragilidad que escala junto con el modelo

Hay un patrón que he visto repetirse en cada ciclo de adopción tecnológica masiva: las empresas que lideran la primera fase de escala son las que tienen la arquitectura técnica más avanzada. Las que lideran la fase de madurez son las que tienen la arquitectura social más robusta. La primera ventaja se puede replicar con capital suficiente. La segunda tarda años en construirse y no se compra en una ronda de financiamiento.

Skild está, por sus propios datos, en el punto de inflexión de la primera fase. El modelo funciona. Los socios están firmados. Los despliegues productivos han comenzado. Lo que determina si esta empresa captura el mercado de automatización en la próxima década no es si Skild Brain puede limpiar un escritorio o insertar un componente en una línea de ensamblaje de NVIDIA. Es si el modelo aprende a funcionar con la misma eficacia en los entornos que sus diseñadores nunca visitaron.

Los directorios de las empresas que están integrando Skild Brain en su infraestructura productiva deben exigir una auditoría de la composición de los datos de entrenamiento con el mismo rigor con que auditan un balance financiero. Un modelo de IA que automatiza decisiones físicas en entornos diversos pero fue entrenado sobre un universo de datos homogéneo no es un activo tecnológico; es un pasivo operativo con fecha de vencimiento incierta.

La próxima vez que el comité de tecnología de cualquiera de estos directorios revise el avance del despliegue, que observe quiénes están sentados alrededor de la mesa donde se tomaron las decisiones de diseño del modelo. Si todos comparten el mismo perfil de formación, la misma geografía de referencia y la misma experiencia del mundo físico, no están mirando una fortaleza competitiva. Están mirando el inventario exacto de sus puntos ciegos colectivos, y esos puntos ciegos ya están codificados en el modelo que acaban de contratar.