KI-Agenten für Unternehmen: Wer die Spielregeln gestaltet

Am 24. Februar 2026 kündigte Anthropic sein Programm für Unternehmensagenten an: ein Set an vorgefertigten Modulen, um sein Claude-Modell in Aufgaben der Finanzen, des Personalwesens, des Rechts und der Technik einzusetzen, verbunden mit Tools wie Gmail, DocuSign und Datenplattformen. Das Announcement war präzise und technisch fundiert. Die Versprechung, die laut Kate Jensen, Direktorin für Amerika, das Versagen des Ansatzes — nicht des Aufwands —, das das Jahr 2025 prägte, korrigiert, ist, dass die KI nun tatsächlich in die realen Arbeitsabläufe von Unternehmen integriert werden kann.

Mit monatlich 100 Millionen Downloads für sein standardisiertes Verbindungssystem und Claude Code, das in nur sechs Monaten zu einem Milliardenprodukt wurde, spekuliert Anthropic nicht. Sie führen aus. Wenn ein Unternehmen dieser Größe derartige Weichenstellungen vornimmt, haben Unternehmensleiter zwei Optionen: die Pressemitteilung lesen oder die Architektur dahinter verstehen.

Ich wähle Letzteres.

Das Versprechen ist modular, das Risiko auch

Das Modell von Anthropic ist aus Produktengineering-Perspektive intelligent. Anstatt eine monolithische Plattform zu verkaufen, die jedes Unternehmen von Grund auf anpassen muss, bietet es funktionale Module — einen Agenten für Finanzmodellierung, einen für Stellenbeschreibungen und einen für technische Spezifikationen —, die IT-Teams innerhalb kontrollierter interner Märkte anpassen können. Matt Piccolella, der Produktverantwortliche, brachte es auf den Punkt: Jede Person sollte ihren eigenen maßgeschneiderten Agenten haben, der zentral verwaltet wird.

Diese modulare Architektur wandelt zuvor fixe Kosten — Berater, Lizenzen für spezialisierte Software, maßgeschneiderte Entwicklungen — in variable Bereitstellungen um, die entsprechend der Nutzung skalieren. Für ein kleines oder mittleres Unternehmen mit begrenzten IT-Ressourcen stellt das einen signifikanten Wandel in der finanziellen Logik dar. Man hört auf, für installierte Kapazitäten zu zahlen, und zahlt stattdessen für operative Ergebnisse.

Aber Modularität hat auch eine dunkle Seite: Jedes Modul erbt die Annahmen des Designers. Ein HR-Agent, der Stellenangebote, Onboarding-Materialien und Vertragsangebote generiert, ist nicht neutral. Er spiegelt die implizite Vorstellung wider, welcher Kandidat wünschenswert ist, welche Sprache professionell ist und welche Karrierewege als normal gelten. Diese Annahmen sind nicht offensichtlich im Code verankert. Sie verbergen sich in den Daten, mit denen das Modell trainiert wurde, und noch früher in den Entscheidungen, die die Auswahl dieser Daten bestimmten.

Die Frage, die in keiner Pressemitteilung zu beantworten ist, lautet: Wer war in diesem Raum?

Wenn blinde Flecken in großem Maßstab automatisiert werden

Ein Punkt in dem Briefing von Anthropic verdient besondere Beachtung: Die Analyse von Millionen von Mensch-Agent-Interaktionen zeigt, dass fast 50 % der agentenbasierten Tätigkeit in der Softwaretechnik konzentriert ist. Finanzen, Gesundheit und Cybersicherheit treten als aufstrebende Sektoren auf. Das bedeutet, dass die Nutzungsmuster, die das Systemdesign beeinflussten — die Verhaltensweisen, die das Modell als "normal" und effizient erlernte — aus einem sehr spezifischen Benutzerprofil stammen.

Software-Engineering-Teams sind in Bezug auf die demografische Zusammensetzung eines der homogensten Segmente der globalen Wirtschaft. Wenn dieses Profil 50 % des Trainingssignals für ein System generiert, das später im Personalwesen, in der Finanzwirtschaft und im Recht eingesetzt wird — Funktionen, die Einstellungen, Entlohnung, Kreditvergabe und Compliance verwalten — verschmutzt die Homogenität des Ursprungs die Breite des Ziels.

Das ist keine Anklage gegen Anthropic. Es ist eine strukturelle Diagnose, die für die gesamte Branche gilt und die Unternehmensleiter, die diese Tools übernehmen, in ihre Risikobewertung einbeziehen müssen. Ein KI-Agent, der die Vorauswahl von Lebensläufen in einer HR-Abteilung automatisiert, kann die Prozessdauer erheblich verkürzen. Er kann jedoch auch die bestehenden Vorurteile in der Geschwindigkeit reproduzieren, die vorher Wochen in Anspruch nahmen. Der Effizienzgewinn und das Risiko von Vorurteilen sind keine sich aufhebenden Kräfte: Sie multiplizieren sich gemeinsam.

Mittlere Unternehmen, die über keine Algorithmen-Auditteams oder Technologie-Ethisch-Büros verfügen, sind besonders anfällig für dieses Muster. Sie nehmen das Tool aufgrund der legitimen Geschwindigkeitsvorteile an und gehen davon aus, dass, wenn es von einem anerkannten Anbieter stammt, das Vorurteilproblem bereits gelöst wurde. Es wurde jedoch nicht gelöst. Es wurde ausgelagert.

Das Netzwerk, das das Werkzeug stützt, ist ebenso wichtig wie das Werkzeug

Es gibt einen weiteren Aspekt dieses Launches, den technische Analysen oft ignorieren. Anthropic kündigte gleichzeitig die Expansion seiner experimentellen Abteilung unter der Leitung eines Mitbegründers von Instagram an sowie die Verpflichtung einer neuen Produktverantwortlichen aus der Branche. Es handelt sich um ein Netzwerk von strategischen Verknüpfungen, das auf überkreuzten Reputationen, gemeinsamen Erfahrungen und angesammeltem Vertrauen in sehr spezifischen Kreisen des Silicon-Valley-Technologie-Ökosystems basiert.

Dieses Netzwerk hat Wert. Es besitzt jedoch sehr konkrete geografische, kulturelle und sektorale Grenzen. Ein Netzwerk sozialen Kapitals, das innerhalb eines bestimmten Rahmens aufgebaut wurde, erkennt die Signale von außerhalb dieses Rahmens nicht. Für Unternehmen, die in lateinamerikanischen, südlichen europäischen oder südostasiatischen Märkten tätig sind, bedeutet das, dass die Produktgestaltungsprioritäten selten ihre spezifischen operativen Reibungen widerspiegeln: unterschiedliche rechtliche Rahmenbedingungen, andere Arbeitsstrukturen und Managementkulturen, die nicht mit den angloamerikanischen Annahmen übereinstimmen, die den vorgefertigten Modulen zugrunde liegen.

Das Versprechen der Anpassung durch private interne Märkte ist real, hat jedoch einen Startpunkt. Und dieser Punkt wurde von einem bestimmten Ort, von bestimmten Menschen und mit bestimmten Erfahrungen aufgebaut. Unternehmen, die dies verstehen, können Wert aus dem System ziehen; Unternehmen, die es nicht verstehen, nehmen kritiklos eine Menge von Annahmen an, die ihnen nicht gehören.

Die Entscheidung, KI-Agenten in Prozessen des Personalwesens, der Finanzen oder des Rechts zu integrieren, ist nicht nur eine technologische Entscheidung. Es ist eine Governance-Entscheidung. Sie umfasst die Wahl, welche Kriterien automatisiert, welche Abläufe beschleunigt und welche Perspektiven durch Unterlassung aus dem Entscheidungsprozess ausgeschlossen werden. Diese Entscheidungen haben messbare operationale Konsequenzen: in der Qualität der Einstellung, in der rechtlichen Exposition und in der Fähigkeit, vielfältige Märkte zu bedienen. Organisationen, die die Übernahme von KI-Agenten wie eine IT-Entscheidung statt eine Vorstandsentcheidung behandeln, unterschätzen das Risiko.

Der Vorstand, der seinen eigenen blinden Fleck nicht sehen konnte

Der Launch von Anthropic ist nicht das Problem. Er fungiert als Spiegel. Er zeigt deutlich, dass die nächste Schicht der Unternehmensinfrastruktur — die Agenten, die Einstellungen verwalten, Kredite bewerten und Verträge entwerfen — von Teams mit sehr ähnlichen Profilen entworfen wird, für Kunden, die ebenfalls tendieren, sich zu ähneln, wobei die Daten Verhaltensweisen widerspiegeln, die zu 50 % aus einem einzigen Sektor stammen.

Führungskräfte, die diese Tools übernehmen, ohne die in ihnen integrierten Annahmen zu überprüfen, sparen keine Zeit. Sie delegieren ihre sensibelsten Entscheidungen an ein System, das nicht auf ihre spezifische Realität kalibriert wurde. Und wenn dieses System versagt — denn das wird es, in irgendeinem Prozess, bei irgendeinem Profil eines Kandidaten oder Clients, das nicht in das Schema passt — wird die Verantwortung nicht beim Anbieter liegen. Sie wird bei demjenigen liegen, der die Übernahme ohne die notwendigen Fragen unterzeichnet hat.

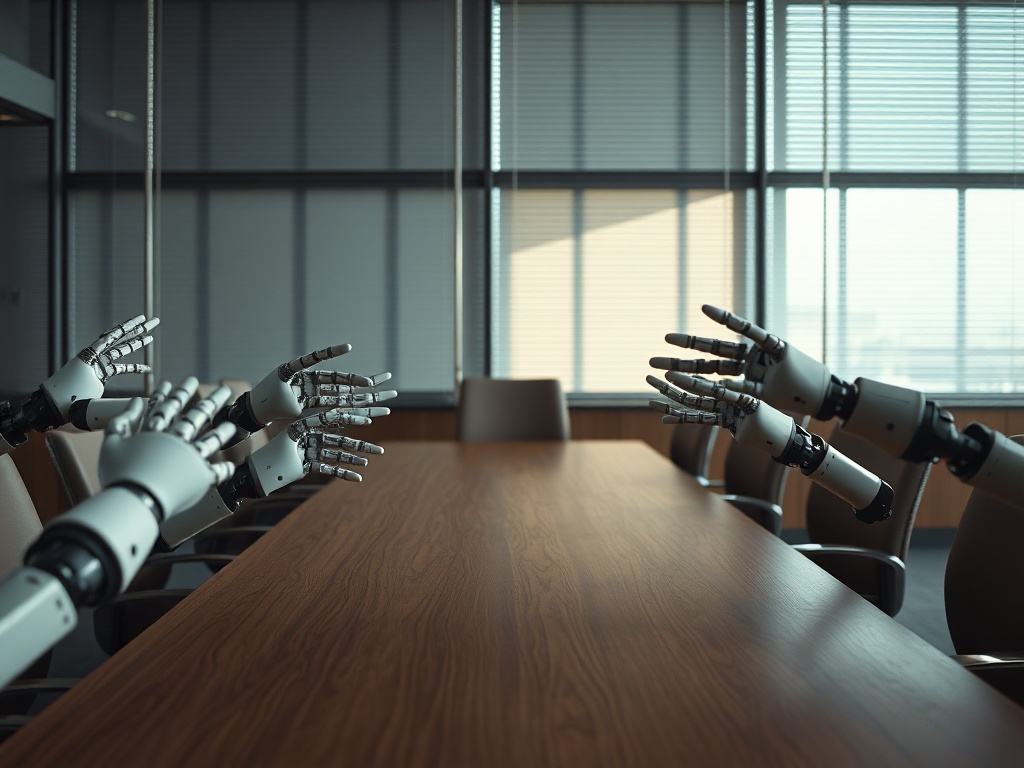

Das nächste Mal, wenn sich der Vorstand trifft, um die Integration von KI-Agenten zu genehmigen, sollten die Anwesenden sich umschauen. Wenn alle denselben Wegen gefolgt sind, in denselben Sektoren gearbeitet haben und dieselben Referenzrahmen teilen, haben sie bereits die Antwort darauf, welche blinden Flecken dieser Vorstand garantiert hat. Und diese blinden Flecken sind genau das, was das System, das sie gerade anzunehmen gedenken, verstärken wird.