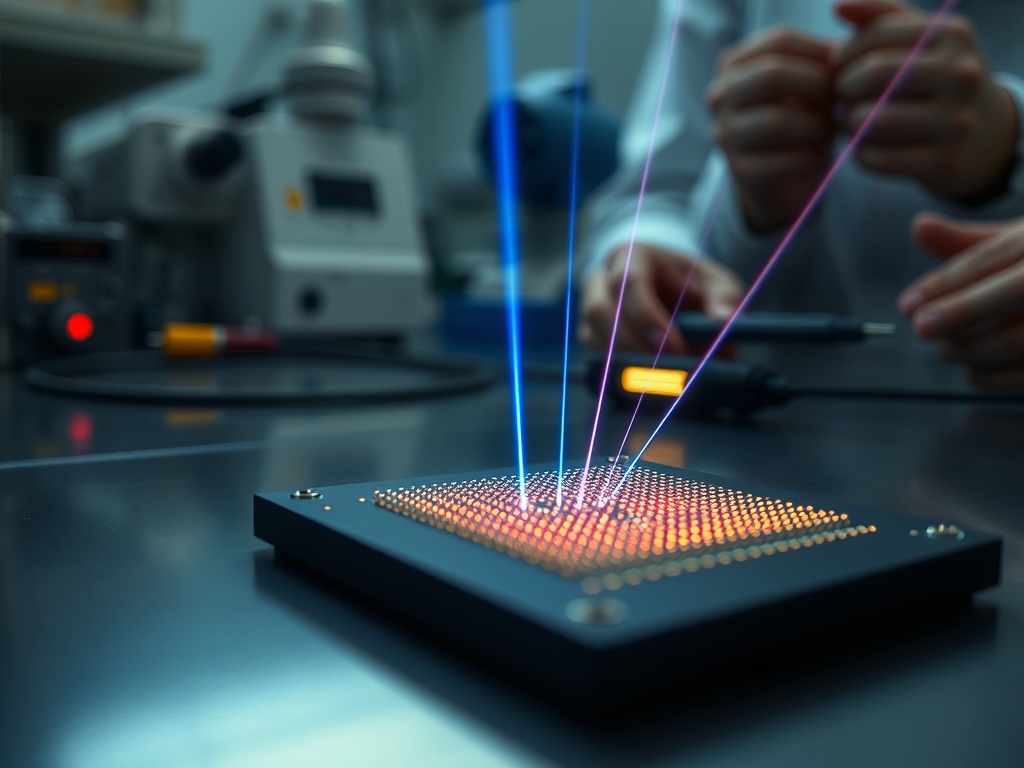

MIT acaba de introduzir uma peça que faltava na conversa sobre escalabilidade quântica: um chip fotônico que emite milhares de feixes laser individualmente controláveis em espaço livre. O detalhe não é estético; é operacional. Em muitas abordagens de computação quântica, a luz não é um acessório, mas o mecanismo de controle. Se se deseja controlar grandes quantidades de qubits, a questão muda de ser "ter um laser" para orquestrar milhares de feixes com precisão repetível, sem que o sistema transforme-se em um laboratório do tamanho de uma sala.

A analogia que utiliza o pesquisador Henry Wen ajuda a entender a escala: como "disparar uma pistola de camisetas" para uma multidão em um estádio, mas com punteria seletiva e simultânea. Esse salto de uma óptica volumétrica para uma plataforma de emissão densa em chip também abre um segundo frente igualmente relevante: o MIT relata, em uma linha paralela, um chip com antenas e guias de onda em escala nanométrica que permite resfriar íons aprisionados a temperaturas quase dez vezes abaixo do limite Doppler padrão, com resfriamento dez vezes mais rápido segundo as informações disponíveis.

Para um executivo, a leitura correta não é a “elegância da fotônica”, mas que tipo de nova infraestrutura é habilitada quando o controle óptico é compactado e fabricado como um componente. O mercado quântico tem estado cheio de promessas; o que começa a surgir aqui é uma via concreta para converter promessas em arquitetura industrial.

Do laboratório à fábrica: o passo crítico é a densidade controlável

O marco técnico, como descrito, é a capacidade de interfacer dois mundos que costumam colidir: o fotônico em chip, onde a luz viaja por guias como se fossem "cabos", e o mundo de espaço livre, onde o feixe se propaga e deve ser direcionado a um alvo físico. A plataforma do laboratório de Englund no MIT incorpora estruturas minúsculas que se curvam para cima a partir da superfície do chip, permitindo lançar e direcionar luz para fora do plano do chip. O resultado declarado é uma matriz com milhares de feixes laser, cada um controlável de forma individual, operando a um limite físico de tamanho de “pixel”.

Essa frase de “limite físico” importa mais do que parece. Em computação e comunicações, a economia de escala se acelera quando um parâmetro se torna denso e repetível: transistores por área, canais por fibra, células por bateria. No controle quântico, essa densidade raramente existe porque a óptica tradicional introduz fricção: alinhamento, vibração, deriva térmica, manutenção e uma forte dependência de pessoal altamente especializado para sustentar a operação.

Em paralelo, o trabalho de resfriamento de íons integra antenas com diversidade de polarização e muescas curvas que geram um vórtice de luz rotatório, maximizando a entrega de luz ao íon e estabilizando o roteamento óptico sem lasers externos volumosos. Desde um ponto de vista de produto, o que se está comprando com isso é estabilidade operacional. Menos óptica externa significa menos vibrações, e em sistemas quânticos isso se traduz em menos erros. Não há cifras de custo nas fontes, mas o mecanismo é claro: compactação e redução de sensibilidade a condições físicas que, hoje, inflacionam o custo de operar protótipos.

O ponto que muitas equipes gerenciais subestimam é que “escalabilidade” não significa apenas mais qubits; significa mais qubits com menos intervenção humana por unidade de capacidade. Quando milhares de feixes se tornam um “motor óptico” sobre silício, abre-se a porta para industrializar, mas também para falhar de forma industrial se a organização não souber governar a transição.

A unidade econômica muda quando o controle óptico se torna componente

Se um chip pode, em uma única peça, emitir e controlar milhares de feixes para o exterior, o custo marginal de adicionar canais de controle tende a se assemelhar mais ao de semicondutores do que ao de óptica de laboratório. É uma mutação da unidade econômica: move-se o gasto da integração manual e calibração para fabricação, embalagem, teste e desempenho de lote.

Essa mutação tem duas implicações empresariais.

Primeiro, reconfigura-se o mapa de fornecedores e capacidades internas. Uma empresa que deseja construir sobre esta classe de plataforma deixa de depender tanto de “magos” de laboratório e passa a depender de engenharia de manufatura, metrologia, controle de qualidade e cadeia de suprimentos. O risco não é mais apenas que o experimento não funcione; o risco é que o desempenho em produção seja imprevisível, ou que a embalagem óptico-mecânica consuma qualquer ganho de integração.

Em segundo lugar, surgem aplicações adjacentes que o próprio relatório menciona como plausíveis, como lidar, impressão 3D de alta velocidade por meio de cura rápida com feixes, e telas de alta resolução. Não é necessário prometer cronogramas que não estão nas fontes. É necessário reconhecer o padrão: quando uma tecnologia de controle de luz escala em canais e controlabilidade, seu destino não é uma única indústria. E quando uma tecnologia se torna multi-indústria, a concorrência se torna assimétrica: começa a competir com empresas que têm músculo de produção, certificações e acesso a mercados finais, não apenas com laboratórios.

Do ponto de vista financeiro, o ângulo sóbrio é este: a vantagem não está apenas na propriedade intelectual, mas na capacidade de levar um artefato delicado a uma linha de produção com especificações repetíveis. Muitas empresas falham aqui por uma razão social, não técnica: suas redes de colaboração são muito fechadas e suas decisões muito concentradas.

O capital social decide se isso escala para além do paper

O MIT enquadra o avanço dentro do Quantum Moonshot Program, com colaboração do MIT, University of Colorado at Boulder, MITRE Corporation e Sandia National Laboratories. Essa lista importa porque mostra uma verdade incômoda da tecnologia profunda: quando o problema é complexo, a execução depende de redes horizontais que conectam pesquisa, engenharia aplicada e necessidades institucionais. Neste caso, além disso, menciona-se o foco em qubits baseados em diamante controlados por laser.

Minha leitura, a partir de diversidade, equidade e capital social, é pragmática: essa classe de plataforma não é conquistada apenas com orçamento, é conquistada com arquitetura de colaboração. Se o poder permanece em uma “mesa pequena” homogênea, a organização tende a otimizar para o que entende: métricas acadêmicas, marcos internos ou integração com a stack que já domina. Isso cria pontos cegos.

Exemplos de pontos cegos típicos em saltos como este, sem atribuí-los a ninguém em particular porque as fontes não descrevem governança interna:

- Quem define os critérios de sucesso. Uma equipe pode declarar vitória por “milhares de feixes”, enquanto operações precisam de tolerâncias, manutenibilidade e protocolos de teste. Se operações entrarem tarde, o custo aparecerá depois, e aparecerá caro.

- Quem opera o sistema quando sai do laboratório. A transição para clientes ou para implementações exige perfis que costumam estar fora do círculo de pesquisa: técnicos, engenheiros de produção, especialistas em segurança a laser, responsáveis pelo compliance. Se esses perfis não tiverem voz cedo, a solução será projetada para o ambiente errado.

- Quem se beneficia do aprendizado. Em tecnologias com barreiras altas, o aprendizado se torna um ativo. Se a organização não tiver mecanismos para “dar primeiro” e compartilhar aprendizados com parceiros e equipes periféricas, o conhecimento se encapsula, se politiza e se freia.

A diversidade aqui não é um slogan. É uma cobertura de risco. Equipes com trajetórias distintas detectam falhas distintas: um vê o desempenho de fabricação, outro vê o protocolo de calibração, outro vê a segurança em campo, outro vê o custo de manutenção. Quando todos se parecem, compartilham o mesmo mapa mental e confundem consenso com certeza.

A disrupção não chega pela física, mas pelo design organizacional

O chip que emite milhares de feixes para espaço livre e o chip que resfria íons com antenas integradas apontam para um mesmo destino: converter controle quântico em infraestrutura compacta. Se esse destino se materializa, o campo deixará de premiar quem tem a melhor montagem artesanal e começará a premiar quem governa melhor uma cadeia de decisões: design, fabricação, teste, embalagem, operação, confiabilidade.

Essa mudança também reordena o poder. A liderança que entende apenas a narrativa científica pode subestimar os gargalos humanos: contratação, treinamento, padrões internos, incentivos entre pesquisa e engenharia, e acordos de colaboração que não se rompem diante do primeiro desacordo por prazos.

Não é para romantizá-lo. Nas fontes, não aparecem tempos de comercialização nem cifras de economia. Portanto, a postura executiva responsável é tratá-lo como o que é: um habilitador técnico com potencial amplo e com incerteza de engenharia de produto. A estratégia vencedora é construir opcionalidade: pilotos, acordos de codesenvolvimento, e, acima de tudo, uma organização capaz de absorver aprendizado sem queimá-lo na política interna.

O mandado para o C-Level é direto: na próxima reunião do conselho, observem sua mesa pequena e reconheçam que se todos forem tão parecidos, inevitavelmente compartilharão os mesmos pontos cegos, o que os torna vítimas iminentes da disrupção.