Agents d'IA pour les PME : qui fixe les règles du jeu

Le 24 février 2026, Anthropic a annoncé son programme d'agents d'entreprise : un ensemble de modules préconstruits pour déployer son modèle Claude dans des tâches de finances, de ressources humaines, de juridique et d'ingénierie, connectés à des outils comme Gmail, DocuSign et des plateformes de données. L'annonce était précise et techniquement solide. La promesse, que selon sa directrice pour l'Amérique, Kate Jensen, corrige le manque d'approche —non d'effort— qui a caractérisé 2025, est que cette fois, l'IA sera véritablement intégrée dans les flux de travail réels des entreprises.

Avec 100 millions de téléchargements mensuels de son protocole de connexion standardisé et Claude Code grimpant pour devenir un produit de facturation milliardaire en six mois, Anthropic ne spécule pas. Elle exécute. Et quand une entreprise de cette envergure fait des mouvements de cette ampleur, les leaders d'entreprise ont deux options : lire le communiqué de presse ou examiner l'architecture sous-jacente.

Je choisis la seconde option.

La promesse est modulaire, le risque aussi

Le modèle d'Anthropic est astucieux en termes d'ingénierie produit. Plutôt que de vendre une plateforme monolithique que chaque entreprise devrait adapter depuis le début, elle offre des modules fonctionnels —un agent pour la modélisation financière, un autre pour générer des descriptions de postes, un autre pour des spécifications techniques— que les équipes informatiques peuvent personnaliser dans des marchés internes contrôlés. Matt Piccolella, son responsable produit, l’a résumé ainsi : chaque personne devrait avoir son propre agent sur mesure, géré depuis le centre.

Cette architecture modulaire transforme les coûts qui étaient autrefois fixes —consultants, licences de logiciel spécialisé, développements sur mesure— en déploiements variables qui évoluent selon l'utilisation. Pour une petite ou moyenne entreprise avec des ressources informatiques limitées, cela représente un changement de logique financière significatif. Finis les paiements pour la capacité installée, place aux paiements pour résultats opérationnels.

Mais la modularité a un revers : chaque module hérite des suppositions de son concepteur. Un agent de RH qui génère des offres d'emploi, des supports d'accueil et des lettres d'offre n'est pas neutre. Il reflète une idée implicite de quel candidat est désirable, quel langage est professionnel, quelle structure de carrière est normale. Ces suppositions ne sont pas visibles dans le code. Elles résident dans les données avec lesquelles le modèle a été formé, et encore plus tôt, dans les décisions de ceux qui ont choisi ces données.

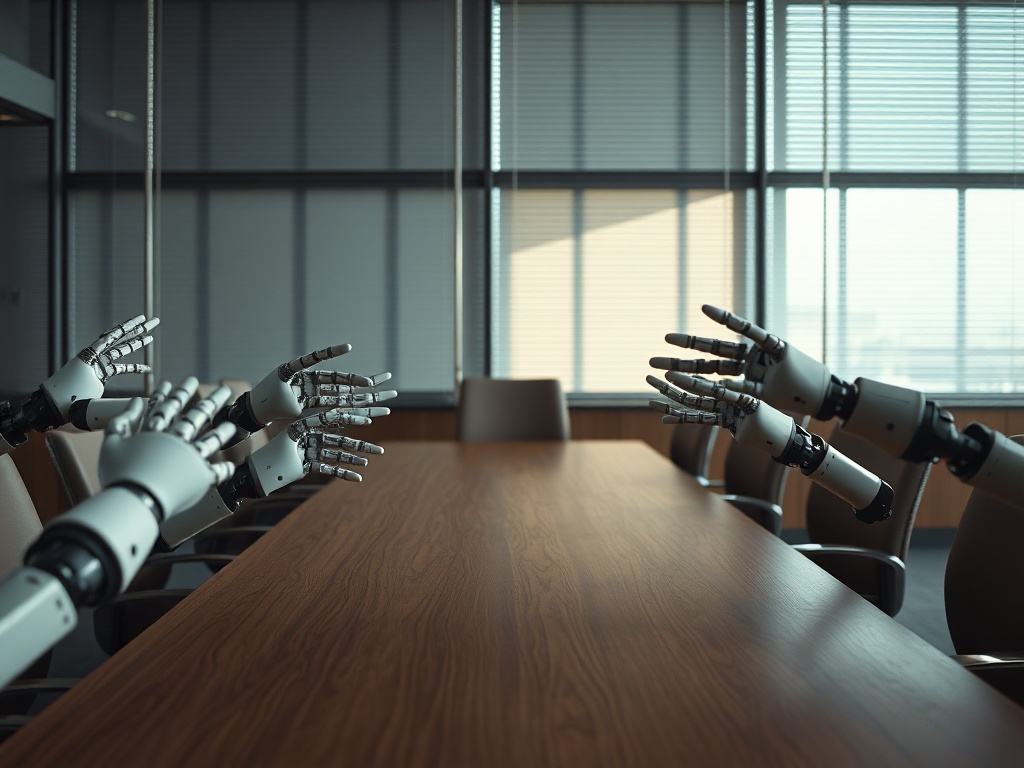

La question à laquelle aucun communiqué de lancement ne répond est : qui était dans cette salle ?

Quand le point aveugle s'automatise à grande échelle

Il y a une donnée dans le briefing d'Anthropic qui mérite une attention particulière : l'analyse de millions d'interactions humain-agent montre que près de 50 % de l'activité agentique se concentre sur l'ingénierie logicielle. Finances, santé et cybersécurité apparaissent comme des secteurs émergents. Cela signifie que les modèles d'utilisation qui ont informé la conception du système —les comportements que le modèle a appris comme "normaux" et efficaces— proviennent d'un profil d'utilisateur très spécifique.

Les équipes d'ingénierie logicielle sont, en termes de composition démographique, l'un des segments de main-d'œuvre les plus homogènes de l'économie mondiale. Lorsque ce profil génère 50 % du signal d'entraînement pour un système qui sera ensuite déployé dans les ressources humaines, les finances et le juridique —des fonctions qui gèrent le recrutement, la compensation, le crédit, la conformité— l'homogénéité d'origine contamine la portée de destination.

Ce n'est pas une accusation d'Anthropic. C'est un diagnostic structurel qui s'applique à toute l'industrie et que les leaders d'entreprise qui adopteront ces outils doivent intégrer dans leur évaluation des risques. Un agent d'IA qui automatise le filtrage des CV dans un département de RH peut réduire le temps du processus de manière substantielle. Il peut également répliquer à une vitesse industrielle les biais qui auparavant prenaient des semaines à se manifester. Le gain d'efficacité et le risque de biais ne sont pas des forces qui se compensent : elles se multiplient ensemble.

Les PME, qui n'ont pas d'équipes d'audit d'algorithmes ni de bureaux d'éthique technologique, sont particulièrement vulnérables à ce schéma. Elles adoptent l'outil pour ses bénéfices de rapidité —légitimes— et supposent que puisque cela vient d'un fournisseur reconnu, le problème de biais a déjà été résolu. Ce n'est pas le cas. Cela a été externalisé.

Le réseau qui soutient l'outil importe autant que l'outil

Il y a un autre angle dans ce lancement que les analyses techniques ont tendance à ignorer. Anthropic a simultanément annoncé l'expansion de sa division expérimentale avec le cofondateur d'Instagram à sa tête et l'incorporation d'une nouvelle responsable produit provenant du secteur. Il s'agit d'un réseau de liens stratégiques construit sur des réputations croisées, des histoires partagées et une confiance accumulée dans des cercles très spécifiques de l'écosystème technologique de Silicon Valley.

Ce réseau a de la valeur. Il a également des limites géographiques, culturelles et sectorielles très concrètes. Un réseau de capital social construit à l'intérieur d'un même périmètre ne détecte pas les signaux provenant de l'extérieur de ce périmètre. Pour les entreprises qui opèrent sur des marchés latino-américains, du sud de l'Europe ou du sud-est asiatique, cela implique que les priorités de conception du produit refléteront rarement leurs frictions opérationnelles spécifiques : cadres juridiques différents, structures de travail variées, cultures de gestion qui ne correspondent pas avec les suppositions anglo-saxonnes sous-jacentes aux modules préconstruits.

La promesse de personnalisation via des marchés internes privés est réelle, mais elle a un seuil de départ. Et ce seuil a été construit d'un certain endroit, par des personnes spécifiques, avec des expériences déterminées. Les entreprises qui comprendront cela pourront tirer de la valeur du système ; celles qui ne le comprendront pas adopteront sans critique un ensemble de suppositions qui ne leur appartiennent pas.

La décision d'intégrer des agents d'IA dans les processus de RH, de finances ou de juridique n'est pas seulement une décision technologique. C'est une décision de gouvernance. Cela implique de choisir quels critères automatiser, quels flux accélérer et, par omission, quelles perspectives restent en dehors du processus décisionnel. Ces choix ont des conséquences opérationnelles mesurables : en qualité de recrutement, en exposition légale, en capacité d'adresser des marchés divers. Les organisations qui traiteront l'adoption d'agents d'IA comme une décision informatique plutôt que comme une décision du conseil d'administration mesurent mal le risque.

Le conseil d'administration qui n'a pas vu venir son propre point aveugle

Le lancement d'Anthropic n'est pas le problème. C'est le miroir. Il montre clairement que la prochaine couche d'infrastructure d'entreprise —les agents qui géreront les recrutements, évalueront les crédits, rédigeront les contrats— est conçue par des équipes avec des profils très similaires entre elles, pour des clients qui tendent également à se ressembler, avec des données qui reflètent des comportements d'utilisateurs dont 50 % proviennent d'un seul secteur.

Les leaders qui adopteront ces outils sans auditer les suppositions qui les intègrent ne seront pas en train d'économiser du temps. Ils délégueront leurs décisions les plus sensibles à un système qui n'a pas été calibré pour leur réalité spécifique. Et quand ce système échouera —car il échouera, à un moment, dans un processus donné, face à un profil de candidat ou de client qui ne correspond pas au moule— la responsabilité ne sera pas celle du fournisseur. Elle sera de ceux qui ont signé l'adoption sans poser les questions nécessaires.

La prochaine fois que le conseil d'administration se réunira pour approuver l'intégration d'agents d'IA, il vaut la peine que chaque personne dans cette salle regarde autour d'elle. Si tous ont emprunté les mêmes chemins, ont travaillé dans les mêmes secteurs et partagent les mêmes cadres de référence, ils ont déjà la réponse sur les points aveugles que ce conseil d'administration a garantis. Et ces points aveugles sont exactement ce que le système qu'ils sont sur le point d'adopter va amplifier.