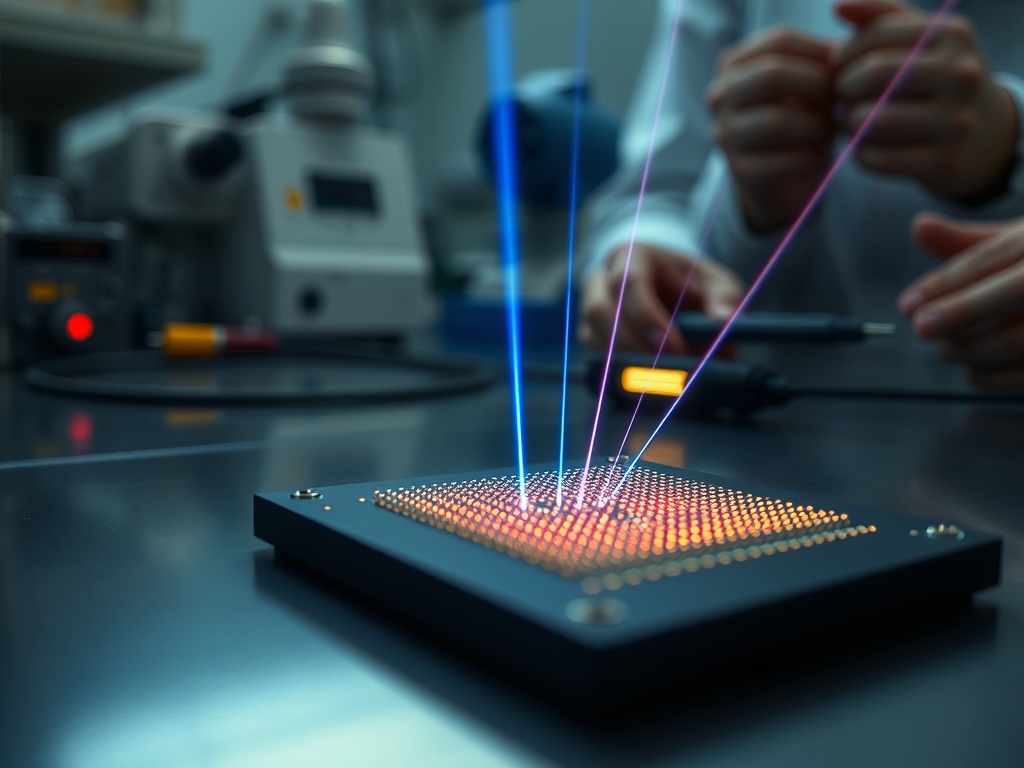

MIT acaba de poner sobre la mesa una pieza que faltaba en la conversación sobre escalabilidad cuántica: un chip fotónico que dispara miles de haces láser individualmente controlables hacia el espacio libre. El detalle no es estético; es operativo. En muchos enfoques de computación cuántica, la luz no es un accesorio, es el mecanismo de control. Si se quiere gobernar grandes cantidades de qubits, el problema deja de ser “tener un láser” y pasa a ser orquestar miles de haces con precisión repetible, sin que el sistema se convierta en un laboratorio del tamaño de una habitación.

La analogía que usa el investigador Henry Wen ayuda a entender la escala: como “disparar una pistola de camisetas” hacia una multitud en un estadio, pero con puntería selectiva y en simultáneo. Ese salto de una óptica volumétrica a una plataforma de emisión densa en chip también abre un segundo frente, igualmente relevante: MIT reporta, en una línea paralela, un chip con antenas y guías de onda a escala nanométrica que permite enfriar iones atrapados a temperaturas casi diez veces por debajo del límite Doppler estándar, con enfriamiento 10 veces más rápido según la cobertura disponible.

Para un ejecutivo, la lectura correcta no es “qué tan elegante es la fotónica”, sino qué nuevo tipo de infraestructura queda habilitada cuando el control óptico se compacta y se fabrica como un componente. El mercado cuántico ha estado lleno de promesas; lo que empieza a aparecer aquí es una vía concreta para convertir promesas en arquitectura industrial.

Del laboratorio a la fábrica el paso crítico es la densidad controlable

El hito técnico, tal como se describe, es la capacidad de interfazar dos mundos que suelen chocar: el fotónico en chip, donde la luz viaja por guías como si fueran “cables”, y el mundo de espacio libre, donde el haz se propaga y debe apuntarse a un objetivo físico. La plataforma del laboratorio de Englund en MIT incorpora estructuras diminutas que curvan hacia arriba desde la superficie del chip, permitiendo lanzar y dirigir luz fuera del plano del chip. El resultado declarado es una matriz con miles de haces láser, cada uno controlable de forma individual, operando a un límite físico de tamaño de “píxel”.

Esta frase de “límite físico” importa más de lo que parece. En computación y comunicaciones, la economía de escala se acelera cuando un parámetro se vuelve denso y repetible: transistores por área, canales por fibra, celdas por batería. En control cuántico, esa densidad rara vez existe porque la óptica tradicional introduce fricción: alineación, vibración, deriva térmica, mantenimiento, y una dependencia fuerte de personal altamente especializado para sostener la operación.

En paralelo, el trabajo de enfriamiento de iones integra antenas con diversidad de polarización y muescas curvas que generan un vórtice de luz rotatorio, maximizando la entrega de luz al ion y estabilizando el ruteo óptico sin láseres externos voluminosos. Desde un punto de vista de producto, lo que se está comprando con esto es estabilidad operativa. Menos óptica externa significa menos vibraciones, y en sistemas cuánticos eso se traduce en menos errores. No hay cifras de costo en las fuentes, pero el mecanismo es claro: compactación y reducción de sensibilidad a condiciones físicas que, hoy, inflan el costo de operar prototipos.

El punto que muchos equipos directivos subestiman es que “escalabilidad” no significa solo más qubits; significa más qubits con menos intervención humana por unidad de capacidad. Cuando miles de haces pasan a ser un “motor óptico” sobre silicio, se abre una puerta a industrializar, pero también a fallar de manera industrial si la organización no sabe gobernar la transición.

La unidad económica cambia cuando el control óptico se convierte en componente

Si un chip puede, en una sola pieza, emitir y controlar miles de haces hacia el exterior, el costo marginal de agregar canales de control tiende a parecerse más al de semiconductores que al de óptica de laboratorio. Es una mutación de unidad económica: se mueve gasto desde integración manual y calibración hacia fabricación, empaquetado, testeo y rendimiento de lote.

Esa mutación tiene dos implicancias empresariales.

Primera, se reconfigura el mapa de proveedores y capacidades internas. Una empresa que quiera construir sobre esta clase de plataforma deja de depender tanto de “magos” de laboratorio y pasa a depender de ingeniería de manufactura, metrología, control de calidad y cadena de suministro. El riesgo ya no es solo que el experimento no funcione; el riesgo es que el rendimiento en producción sea impredecible, o que el empaquetado óptico-mecánico se coma cualquier ganancia de integración.

Segunda, aparecen aplicaciones adyacentes que el propio reporte menciona como plausibles, como lidar, impresión 3D de alta velocidad mediante curado rápido por haces, y pantallas de alta resolución. No hace falta prometer cronogramas que no están en las fuentes. Sí hace falta reconocer el patrón: cuando una tecnología de control de luz escala en canales y controlabilidad, su destino no es una sola industria. Y cuando una tecnología se vuelve multi-industria, la competencia se vuelve asimétrica: se entra a competir con empresas que tienen músculo de producción, certificaciones y acceso a mercados finales, no solo con laboratorios.

Desde finanzas, el ángulo sobrio es este: la ventaja no está solo en la propiedad intelectual, sino en la capacidad de llevar un artefacto delicado a una línea de producción con especificaciones repetibles. Muchas compañías fallan aquí por una razón social, no técnica: sus redes de colaboración son demasiado cerradas y sus decisiones demasiado concentradas.

El capital social decide si esto escala fuera del paper

MIT enmarca el avance dentro del Quantum Moonshot Program, con colaboración de MIT, University of Colorado at Boulder, MITRE Corporation y Sandia National Laboratories. Esa lista importa porque muestra una verdad incómoda de la tecnología profunda: cuando el problema es complejo, la ejecución depende de redes horizontales que conectan investigación, ingeniería aplicada y necesidades institucionales. En este caso, además, se menciona el foco en qubits basados en diamante controlados por láser.

Mi lectura, desde diversidad, equidad y capital social, es pragmática: esta clase de plataforma no se gana solo con presupuesto, se gana con arquitectura de colaboración. Si el poder se queda en una “mesa chica” homogénea, la organización tiende a optimizar para lo que entiende: métricas académicas, hitos internos, o integración con el stack que ya domina. Eso fabrica puntos ciegos.

Ejemplos de puntos ciegos típicos en saltos como este, sin atribuirlos a nadie en particular porque las fuentes no describen gobernanza interna:

- Quién define los criterios de éxito. Un equipo puede declarar victoria por “miles de haces”, mientras operaciones necesita tolerancias, mantenibilidad y protocolos de testeo. Si operaciones entra tarde, el costo aparece después, y aparece caro.

- Quién opera el sistema cuando sale del laboratorio. La transición a clientes o a despliegues exige perfiles que suelen estar fuera del círculo de investigación: técnicos, ingenieros de producción, especialistas en seguridad láser, responsables de compliance. Si esos perfiles no tienen voz temprano, la solución se diseña para el entorno equivocado.

- Quién se beneficia del aprendizaje. En tecnologías con barreras altas, el aprendizaje se convierte en un activo. Si la organización no tiene mecanismos de “dar primero” y compartir aprendizajes con socios y equipos periféricos, el conocimiento se encapsula, se politiza y se frena.

La diversidad aquí no es un eslogan. Es una cobertura de riesgo. Equipos con trayectorias distintas detectan fallas distintas: uno ve el rendimiento de fabricación, otro ve el protocolo de calibración, otro ve la seguridad en campo, otro ve el costo de mantenimiento. Cuando todos se parecen, se reparten el mismo mapa mental y confunden consenso con certeza.

La disrupción no llega por la física llega por el diseño organizacional

El chip que lanza miles de haces a espacio libre y el chip que enfría iones con antenas integradas apuntan a un mismo destino: convertir control cuántico en infraestructura compacta. Si ese destino se materializa, el campo deja de premiar al que tiene el mejor montaje artesanal y empieza a premiar al que gobierna mejor una cadena de decisiones: diseño, fabricación, test, empaquetado, operación, confiabilidad.

Ese cambio también reordena el poder. El liderazgo que entiende solo la narrativa científica puede subestimar los cuellos de botella humanos: contratación, entrenamiento, estándares internos, incentivos entre investigación e ingeniería, y acuerdos de colaboración que no se rompan ante el primer desacuerdo por plazos.

No hay que romantizarlo. En las fuentes no aparecen tiempos de comercialización ni cifras de ahorro. Por lo tanto, la postura ejecutiva responsable es tratarlo como lo que es: un habilitador técnico con potencial amplio y con incertidumbre de ingeniería de producto. La estrategia ganadora es construir opcionalidad: pilotos, acuerdos de codesarrollo, y sobre todo una organización capaz de absorber aprendizaje sin quemarlo en política interna.

El mandato para el C-Level es directo: en la próxima reunión de directorio, observen su mesa chica y reconozcan que si todos son tan parecidos, comparten inevitablemente los mismos puntos ciegos, lo que los convierte en víctimas inminentes de la disrupción.