L'IA quantique qui prédit le chaos et transforme le contrôle du calcul scientifique

Prédire la turbulence d'un fluide avec une précision soutenue dans le temps est l'un des problèmes les plus coûteux de la physique computationnelle. Les équations de Navier-Stokes résistent depuis plus d'un siècle aux solutions efficaces, et les modèles d'IA classiques échouent sur des horizons longs parce qu'ils accumulent les erreurs de manière systématique. Le 17 avril 2026, des chercheurs de l'University College London ont publié dans Science Advances un résultat qui mérite d'être lu attentivement : un modèle d'IA entraîné avec des données prétraitées par un ordinateur quantique de 20 qubits a obtenu 20 % de précision supplémentaire dans la prédiction de systèmes chaotiques et a nécessité des centaines de fois moins de mémoire que les approches classiques équivalentes.

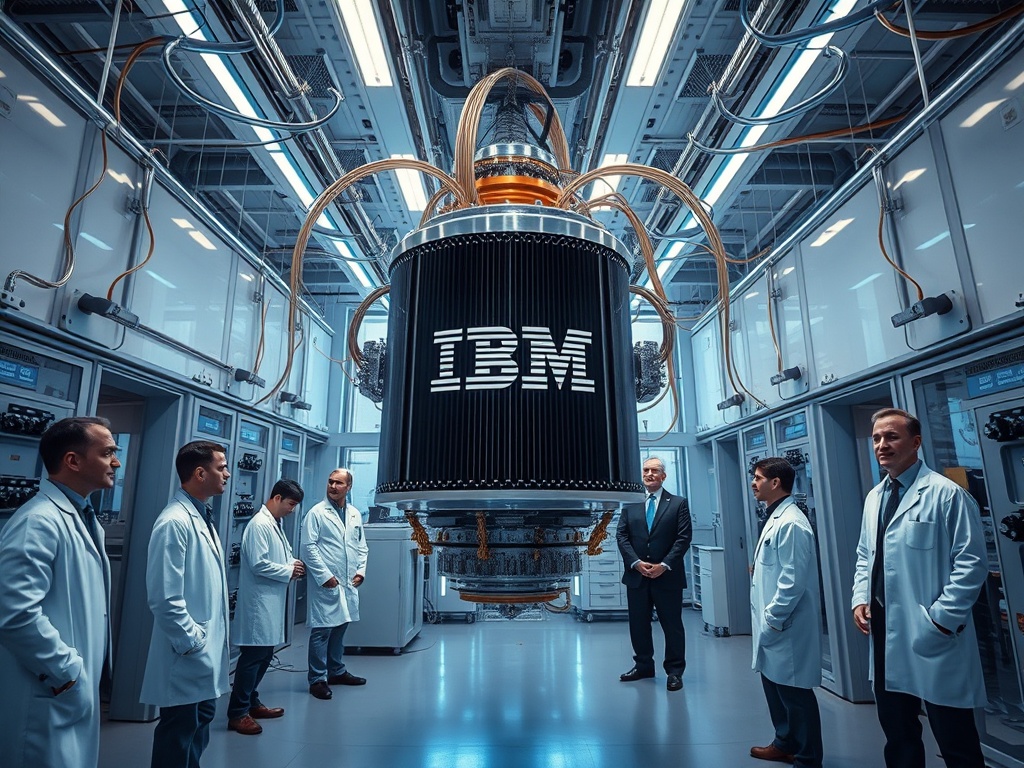

L'expérience a utilisé un ordinateur quantique d'IQM connecté au Centre de supercalcul Leibniz en Allemagne. L'architecture est hybride par conception : l'ordinateur quantique intervient une seule fois pour extraire les propriétés statistiques invariantes du système — des motifs qui persistent dans le temps même si le système est chaotique — puis l'entraînement s'effectue sur une infrastructure classique conventionnelle. Il ne s'agit pas d'un remplacement total du matériel classique. C'est une intervention chirurgicale précise au point exact où le calcul classique est le moins efficace.

Ce n'est pas un détail mineur. C'est le choix architectural qui fait que ce résultat importe bien au-delà du laboratoire.

Pourquoi l'efficacité mémoire transforme l'économie du problème

Lorsque le professeur Peter Coveney, auteur principal de l'étude, mentionne des applications dans la prédiction climatique, la conception de parcs éoliens et la simulation de flux sanguin, il ne spécule pas : il décrit des industries où le coût computationnel des simulations de dynamique des fluides constitue un goulet d'étranglement opérationnel au prix bien connu. Les centres météorologiques nationaux dépensent des centaines de millions de dollars par an en infrastructure de supercalcul. Les entreprises pharmaceutiques consacrent une fraction significative de leur budget de R&D à des simulations moléculaires qui dépendent d'approximations, parce que le calcul exact est irréalisable.

Une réduction de plusieurs centaines de fois de l'utilisation de la mémoire n'est pas une amélioration incrémentale. Cela signifie que certains problèmes qui requièrent aujourd'hui un supercalculateur de première ligne pourraient être exécutés sur une infrastructure de gamme intermédiaire. Cela déplace vers le bas de la chaîne le seuil d'accès à la technologie, et ce déplacement entraîne des conséquences distributives directes.

La question stratégique n'est pas de savoir si la méthode fonctionne — l'article évalué par les pairs le confirme — mais de savoir qui capte l'efficacité générée. Si IQM et les centres de supercalcul comme Leibniz construisent l'accès à cette capacité comme un service fermé et à prix élevé, la réduction des coûts reste acquise au fournisseur. Si le flux de travail hybride est documenté, standardisé et rendu reproductible sur du matériel accessible, le bénéfice se distribue vers les laboratoires climatiques, les universités et les PME du secteur énergétique qui ne peuvent aujourd'hui pas se permettre ces simulations.

Il n'existe pas de réponse technique à ce dilemme. C'est une décision de modèle économique que les financeurs — UCL, l'Engineering and Physical Sciences Research Council du Royaume-Uni, IQM et Leibniz — prendront au cours des 18 à 36 prochains mois.

Le schéma que le marché quantique répète et ses conséquences

Ce résultat survient à un moment où le récit du calcul quantique est sous pression. Pendant des années, le secteur a promis la suprématie quantique comme un événement singulier et définitif. Ce qui émerge est plus nuancé et, du point de vue de la valeur appliquée, bien plus intéressant : des avantages spécifiques, limités à des tâches concrètes, intégrés à l'infrastructure classique existante.

Google Quantum AI a annoncé en octobre 2025 une accélération de 13 000 fois par rapport au supercalculateur Frontier dans des simulations de physique utilisant son processeur de 65 qubits. Une équipe chinoise de l'Université des sciences et technologies de Chine a publié en mars 2026 un système de neuf spins quantiques qui reproduit les performances d'un réseau classique de 10 000 nœuds dans la prédiction météorologique. Le résultat de l'UCL s'ajoute à ce schéma : des avantages démontrables, non pas dans des benchmarks abstraits, mais dans des problèmes à valeur économique directe.

Le risque structurel de ce schéma est bien connu dans l'industrie des logiciels d'entreprise. Lorsqu'une capacité passe du stade expérimental au stade démontrable, le marché fait face à une bifurcation : les fournisseurs qui contrôlent l'accès peuvent extraire une rente de position, ou ils peuvent construire sur des standards ouverts permettant une adoption massive. La première option maximise les revenus à court terme ; la seconde construit un marché suffisamment large pour que tous les acteurs de l'écosystème gagnent davantage en termes absolus.

Le bilan des logiciels scientifiques haute performance suggère que les modèles ouverts — ou semi-ouverts avec support commercial — tendent à capter davantage de marché total que les modèles fermés. Le calcul hybride quantique n'a pas de raisons structurelles d'y faire exception, mais rien ne garantit non plus que les principaux acteurs prendront cette décision.

La valeur qui s'accumule là où l'on en parle le moins

La première auteure de l'étude, Maida Wang, a décrit le résultat comme une démonstration d'« avantage quantique pratique ». La distinction entre « pratique » et « théorique » est celle qui détermine si ce travail génère de la valeur économique ou demeure un jalon académique. Pratique signifie que le flux de travail est reproductible sur du matériel existant, que les coûts opérationnels sont maîtrisables et que le résultat passe à l'échelle avec des données réelles — et pas seulement avec des simulations de laboratoire.

L'équipe de l'UCL reconnaît explicitement que les résultats actuels sont validés sur des données de simulation, et que l'extension à des données climatiques ou de turbulence réelle figure dans la feuille de travail en attente. Cet écart entre validation simulée et validation sur le terrain est là où se concentre le risque d'adoption. Ce n'est pas un problème technique insurmontable, mais c'est bien le point où de nombreuses avancées computationnelles ont perdu leur élan.

Ce qui différencie ce cas, c'est l'architecture de financement et de collaboration. IQM a un intérêt direct à ce que le matériel quantique démontre sa valeur appliquée auprès de clients institutionnels. Leibniz a un intérêt à se positionner comme nœud de calcul hybride pour la recherche européenne. L'UCL dispose d'incitations académiques et de transfert de technologie. Ces trois ensembles d'incitations sont alignés dans la direction de mener le résultat vers une validation sur le terrain, ce qui ne correspond pas à la situation habituelle de la recherche quantique fondamentale.